Tu API gateway esta delante de cada request. Maneja autenticacion, rate limiting, routing y a veces caching. Es el punto unico por el que pasa cada llamada a tu API.

Lo que lo convierte en el punto unico donde las cosas pueden fallar sin que nadie se de cuenta.

Metricas de API Gateway que importan

1. Latencia de request (total vs integracion)

Latencia total es el round-trip completo. Latencia de integracion es solo el tiempo que tu backend tarda en procesar. La diferencia es overhead del gateway — auth, transformaciones, logging.

Si la latencia de integracion es baja pero la total es alta, el problema esta en el gateway, no en tu backend.

2. Error rates — 4xx vs 5xx

- Spike de 4xx — Cambio del lado del cliente: deploy de frontend roto, API keys expiradas

- Spike de 5xx — El gateway o backend esta fallando

- 429 (Too Many Requests) — Rate limiting activo. Puede ser proteccion legitima o limites mal configurados

- 502/504 — Backend inalcanzable o demasiado lento

3. Tasa de throttling

Cuantos requests estan siendo rechazados por rate limits. Algo de throttling es intencional. Demasiado significa que estas bloqueando usuarios reales.

4. Cache hit rate

- Arriba de 80%: Caching efectivo

- 50-80%: Decente, revisar TTL y cache keys

- Debajo de 50%: Algo anda mal

5. Request count por ruta y metodo

La distribucion de trafico te dice donde enfocar optimizacion. El endpoint con 3% del trafico puede generar el 80% de tus ingresos.

Monitoreo de AWS API Gateway

AWS API Gateway publica metricas a CloudWatch automaticamente. Habilita metricas detalladas para breakdowns por ruta:

aws apigateway update-stage \

--rest-api-id your-api-id \

--stage-name prod \

--patch-operations \

op=replace,path=/~1*/metrics/enabled,value=trueMetricas clave de CloudWatch: Count, Latency, IntegrationLatency, 4XXError, 5XXError, CacheHitCount.

Monitoreo de Kong Gateway

Kong expone metricas via el plugin de Prometheus:

curl -X POST http://localhost:8001/plugins \

--data "name=prometheus" \

--data "config.status_code_metrics=true" \

--data "config.latency_metrics=true" \

--data "config.bandwidth_metrics=true"Queries utiles de PromQL para Grafana:

# Error rate por servicio

sum(rate(kong_http_requests_total{code=~"5.."}[5m])) by (service)

/

sum(rate(kong_http_requests_total[5m])) by (service)

# P95 latencia por ruta

histogram_quantile(0.95,

sum(rate(kong_request_latency_ms_bucket[5m])) by (le, route)

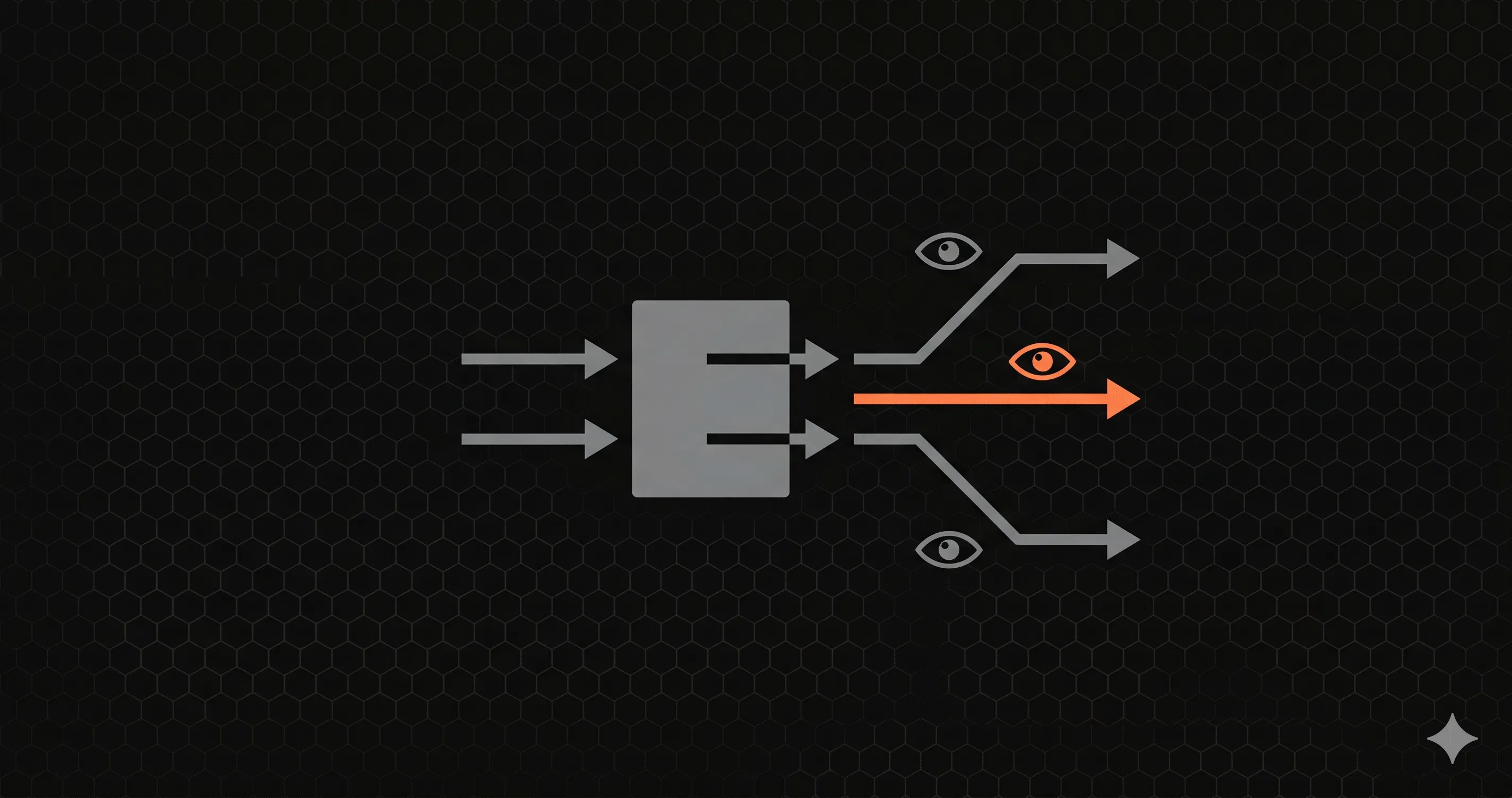

)El gap: lo que los gateways no monitorean

Las metricas del gateway te dicen que paso en el borde de la red. No te dicen que paso dentro de tu aplicacion:

- El gateway ve latencia total — no ve donde dentro de la app se gasto el tiempo

- El gateway ve status codes HTTP — no ve errores de logica de negocio devueltos como 200

- El gateway ve health binario (arriba/abajo) — no ve degradacion parcial

Monitoreo de gateway te dice el sintoma. Monitoreo a nivel de aplicacion te dice la causa.

Llenando el gap con Nurbak Watch

Para aplicaciones Next.js detras de un API gateway, Nurbak Watch provee visibilidad a nivel de aplicacion:

// instrumentation.ts

import { initWatch } from '@nurbak/watch'

export function register() {

initWatch({

apiKey: process.env.NURBAK_WATCH_KEY,

})

}Corre dentro de tu servidor — downstream del gateway. Ve cada request despues de auth, rate limiting y cache. Agrega latencia server-side por ruta, error rates reales, tracking de cold starts y alertas por Slack, email o WhatsApp en menos de 10 segundos.

Stack recomendado

| Capa | Herramienta | Que monitorea |

|---|---|---|

| Gateway | CloudWatch / Prometheus | Trafico, throttling, cache, errores de gateway |

| Aplicacion | Nurbak Watch | Latencia server-side, error rates, cold starts |

| Uptime | Ping externo (UptimeRobot) | Deteccion de caida total |

Empeza gratis

Nurbak Watch esta en beta y es gratis durante el lanzamiento. Complementa tu monitoreo de gateway con las metricas a nivel de aplicacion que hoy no tenes.